A Linguagem de Programação Rust

por Steve Klabnik, Carol Nichols e Chris Krycho, com contribuições da Comunidade Rust

Esta versão do texto pressupõe que você está usando Rust 1.90.0 (lançado em

2025-09-18) ou posterior, com edition = "2024" no arquivo Cargo.toml de

todos os projetos para configurá-los com as convenções idiomáticas da edição

Rust 2024. Consulte a seção “Instalação” do Capítulo 1 para instruções de instalação ou atualização do Rust e veja o Apêndice

E para informações sobre edições.

O formato HTML está disponível online em

https://doc.rust-lang.org/stable/book/

e offline nas instalações do Rust feitas com rustup; execute rustup doc --book para abri-lo.

Também há várias [traduções] mantidas pela comunidade.

Este texto também está disponível em formato impresso e ebook pela No Starch Press.

🚨 Quer uma experiência de aprendizado mais interativa? Experimente outra versão do Rust Book, com: questionários, destaques, visualizações e mais: https://rust-book.cs.brown.edu

Prefácio

A linguagem de programação Rust percorreu um longo caminho em poucos anos: de sua criação e incubação por uma comunidade pequena e ainda nascente de entusiastas até se tornar uma das linguagens de programação mais admiradas e mais procuradas do mundo. Olhando em retrospecto, era inevitável que o poder e a promessa do Rust chamassem atenção e conquistassem espaço na programação de sistemas. O que não era inevitável era o crescimento global do interesse e da inovação que se espalhou pelas comunidades de código aberto e catalisou a adoção em larga escala em diversos setores.

Hoje, é fácil apontar os excelentes recursos que o Rust oferece para explicar essa explosão de interesse e adoção. Quem não quer segurança de memória, e alto desempenho, e um compilador amigável, e ótimas ferramentas, entre tantos outros benefícios? A linguagem Rust que você vê hoje combina anos de pesquisa em programação de sistemas com a sabedoria prática de uma comunidade vibrante e apaixonada. Essa linguagem foi projetada com propósito e lapidada com cuidado, oferecendo a desenvolvedoras e desenvolvedores uma ferramenta que facilita a escrita de código seguro, rápido e confiável.

Mas o que torna o Rust realmente especial é sua raiz em capacitar você, a pessoa usuária, a alcançar seus objetivos. Esta é uma linguagem que quer ver você ter sucesso, e esse princípio de capacitação percorre o núcleo da comunidade que constrói, mantém e promove a linguagem. Desde a edição anterior deste texto de referência, Rust se desenvolveu ainda mais e se tornou uma linguagem verdadeiramente global e confiável. O Projeto Rust agora conta com forte apoio da Rust Foundation, que também investe em iniciativas importantes para garantir que Rust permaneça seguro, estável e sustentável.

Esta edição de A Linguagem de Programação Rust é uma atualização abrangente, refletindo a evolução da linguagem ao longo dos anos e trazendo informações novas valiosas. Mas ela não é apenas um guia de sintaxe e bibliotecas: é um convite para participar de uma comunidade que valoriza qualidade, desempenho e design cuidadoso. Seja você uma pessoa desenvolvedora experiente querendo explorar Rust pela primeira vez, seja alguém já experiente em Rust buscando refinar suas habilidades, esta edição oferece algo para todo mundo.

A jornada do Rust tem sido feita de colaboração, aprendizado e iteração. O crescimento da linguagem e do seu ecossistema reflete diretamente a comunidade vibrante e diversa por trás dela. As contribuições de milhares de desenvolvedores, desde quem projeta o núcleo da linguagem até contribuidores eventuais, são o que fazem do Rust uma ferramenta tão singular e poderosa. Ao pegar este livro, você não está apenas aprendendo uma nova linguagem de programação: está se juntando a um movimento para tornar o software melhor, mais seguro e mais prazeroso de desenvolver.

Boas-vindas à comunidade Rust!

- Bec Rumbul, Diretora-Executiva da Rust Foundation

Introdução

Nota: Esta edição do livro é a mesma de The Rust Programming Language, disponível em formato impresso e ebook pela No Starch Press.

Boas-vindas a A Linguagem de Programação Rust, um livro introdutório sobre Rust. A linguagem de programação Rust ajuda você a escrever software mais rápido e mais confiável. Ergonomia de alto nível e controle de baixo nível costumam entrar em conflito no design de linguagens de programação; Rust desafia esse conflito. Ao equilibrar grande capacidade técnica com uma ótima experiência para desenvolvedores, Rust oferece a opção de controlar detalhes de baixo nível, como o uso de memória, sem toda a dificuldade tradicionalmente associada a esse tipo de controle.

Para quem Rust é indicado

Rust é ideal para muita gente por vários motivos. Vamos olhar para alguns dos grupos mais importantes.

Equipes de desenvolvimento

Rust tem se mostrado uma ferramenta produtiva para colaboração entre grandes equipes com níveis variados de conhecimento em programação de sistemas. Código de baixo nível é propenso a vários bugs sutis que, na maioria das outras linguagens, só podem ser detectados com testes extensivos e revisão de código cuidadosa feita por pessoas experientes. Em Rust, o compilador atua como uma espécie de guardião ao se recusar a compilar código com esses bugs difíceis de encontrar, inclusive bugs de concorrência. Trabalhando junto com o compilador, a equipe pode dedicar seu tempo à lógica do programa em vez de sair caçando bugs.

Rust também traz ferramentas modernas para desenvolvedores ao mundo da programação de sistemas:

- O Cargo, gerenciador de dependências e ferramenta de build incluídos, torna simples e consistente adicionar, compilar e gerenciar dependências em todo o ecossistema Rust.

- A ferramenta de formatação

rustfmtgarante um estilo de código consistente entre diferentes pessoas desenvolvedoras. - O Rust Language Server viabiliza integração com ambientes de desenvolvimento integrados (IDEs), oferecendo autocompletar e mensagens de erro inline.

Ao usar essas e outras ferramentas do ecossistema Rust, pessoas desenvolvedoras podem ser produtivas mesmo escrevendo código em nível de sistema.

Estudantes

Rust também é para estudantes e para pessoas interessadas em aprender conceitos de sistemas. Usando Rust, muita gente aprendeu sobre tópicos como desenvolvimento de sistemas operacionais. A comunidade é bastante acolhedora e fica feliz em responder às dúvidas de estudantes. Por meio de esforços como este livro, as equipes do Rust querem tornar conceitos de sistemas mais acessíveis a mais pessoas, especialmente quem está começando a programar.

Empresas

Centenas de empresas, grandes e pequenas, usam Rust em produção para diversas tarefas, incluindo ferramentas de linha de comando, serviços web, tooling de DevOps, dispositivos embarcados, análise e transcodificação de áudio e vídeo, criptomoedas, bioinformática, motores de busca, aplicações de Internet das Coisas, aprendizado de máquina e até partes importantes do navegador Firefox.

Pessoas desenvolvedoras de código aberto

Rust é para quem quer construir a linguagem de programação Rust, sua comunidade, ferramentas para desenvolvedores e bibliotecas. Adoraríamos contar com a sua contribuição para a linguagem Rust.

Pessoas que valorizam velocidade e estabilidade

Rust é para quem deseja velocidade e estabilidade em uma linguagem. Por velocidade, queremos dizer tanto a rapidez com que o código Rust pode executar quanto a velocidade com que Rust permite escrever programas. As verificações do compilador Rust garantem estabilidade durante a adição de recursos e a refatoração. Isso contrasta com o código legado frágil em linguagens sem essas verificações, que desenvolvedores costumam ter receio de modificar. Ao buscar abstrações de custo zero, isto é, recursos de nível mais alto que compilam para código de baixo nível tão rápido quanto código escrito manualmente, Rust se esforça para fazer com que código seguro também seja código rápido.

A linguagem Rust espera dar suporte a muitos outros perfis de usuário também; os mencionados aqui são apenas alguns dos grupos mais importantes. No geral, a maior ambição do Rust é eliminar os trade-offs que programadores aceitaram por décadas, oferecendo segurança e produtividade, velocidade e ergonomia. Experimente Rust e veja se as escolhas da linguagem funcionam para você.

Para quem este livro é indicado

Este livro presume que você já escreveu código em outra linguagem de programação, mas não faz suposições sobre qual seja. Tentamos tornar o material amplamente acessível para pessoas com os mais diversos históricos de programação. Não gastamos muito tempo explicando o que é programação ou como pensar sobre ela. Se você é totalmente iniciante em programação, será melhor atendido por um livro que ofereça especificamente uma introdução à programação.

Como usar este livro

Em geral, este livro presume que você o está lendo em sequência, do começo ao fim. Capítulos posteriores se baseiam em conceitos apresentados antes, e os capítulos iniciais podem não se aprofundar em certos assuntos porque voltarão a eles em mais detalhes depois.

Você encontrará dois tipos de capítulos neste livro: capítulos conceituais e capítulos de projeto. Nos capítulos conceituais, você aprenderá sobre algum aspecto do Rust. Nos capítulos de projeto, construiremos pequenos programas juntos, aplicando o que você aprendeu até aquele ponto. Os Capítulos 2, 12 e 21 são capítulos de projeto; os demais são capítulos conceituais.

O Capítulo 1 explica como instalar Rust, como escrever um programa “Hello, world!” e como usar o Cargo, o gerenciador de pacotes e ferramenta de build do Rust. O Capítulo 2 é uma introdução prática à escrita de um programa em Rust, fazendo você construir um jogo de adivinhação. Ali, cobrimos conceitos em alto nível, e capítulos posteriores darão detalhes adicionais. Se você quer colocar a mão na massa logo de início, o Capítulo 2 é o lugar certo. Se você é um tipo de aprendiz especialmente meticuloso e prefere entender cada detalhe antes de avançar, talvez queira pular o Capítulo 2 e ir direto ao Capítulo 3, que cobre recursos do Rust parecidos com os de outras linguagens de programação; depois, você pode voltar ao Capítulo 2 quando quiser trabalhar em um projeto que aplique os detalhes aprendidos.

No Capítulo 4, você aprenderá sobre o sistema de ownership do Rust. O

Capítulo 5 discute structs e métodos. O Capítulo 6 cobre enums,

expressões match e as construções de fluxo de controle if let e

let...else. Você usará structs e enums para criar tipos personalizados.

No Capítulo 7, você aprenderá sobre o sistema de módulos do Rust e sobre as regras de privacidade para organizar seu código e sua interface pública de programação de aplicações (API). O Capítulo 8 discute algumas estruturas de dados de coleção comuns fornecidas pela biblioteca padrão: vetores, strings e hash maps. O Capítulo 9 explora a filosofia e as técnicas de tratamento de erros em Rust.

O Capítulo 10 se aprofunda em genéricos, traits e lifetimes, que dão a

você o poder de definir código aplicável a múltiplos tipos. O Capítulo 11

é inteiramente dedicado a testes, que, mesmo com as garantias de segurança do

Rust, ainda são necessários para assegurar que a lógica do programa está

correta. No Capítulo 12, construiremos nossa própria implementação de um

subconjunto da funcionalidade do utilitário de linha de comando grep, que

busca texto dentro de arquivos. Para isso, usaremos muitos dos conceitos

discutidos nos capítulos anteriores.

O Capítulo 13 explora closures e iteradores, recursos do Rust vindos de linguagens de programação funcionais. No Capítulo 14, examinaremos o Cargo em mais profundidade e falaremos sobre boas práticas para compartilhar suas bibliotecas com outras pessoas. O Capítulo 15 discute smart pointers fornecidos pela biblioteca padrão e os traits que habilitam sua funcionalidade.

No Capítulo 16, veremos diferentes modelos de programação concorrente e falaremos sobre como Rust ajuda você a programar com múltiplas threads sem medo. No Capítulo 17, daremos continuidade a isso explorando a sintaxe async e await do Rust, junto com tasks, futures e streams, e o modelo de concorrência leve que eles possibilitam.

O Capítulo 18 observa como os idioms do Rust se comparam a princípios de programação orientada a objetos com os quais você talvez já esteja familiarizado. O Capítulo 19 é uma referência sobre padrões e pattern matching, formas poderosas de expressar ideias em programas Rust. O Capítulo 20 reúne uma variedade de tópicos avançados de interesse, incluindo Rust inseguro, macros e mais detalhes sobre lifetimes, traits, tipos, funções e closures.

No Capítulo 21, concluiremos um projeto no qual implementaremos um servidor web multithread de baixo nível!

Por fim, alguns apêndices contêm informações úteis sobre a linguagem em um formato mais voltado a referência. O Apêndice A cobre as palavras-chave do Rust, o Apêndice B cobre operadores e símbolos, o Apêndice C cobre traits deriváveis fornecidos pela biblioteca padrão, o Apêndice D cobre algumas ferramentas úteis de desenvolvimento, e o Apêndice E explica as edições do Rust. No Apêndice F, você encontra traduções do livro, e no Apêndice G veremos como o Rust é feito e o que é o Rust nightly.

Não existe jeito errado de ler este livro: se quiser pular adiante, vá em frente! Talvez você precise voltar a capítulos anteriores se encontrar alguma confusão. Mas faça o que funcionar melhor para você.

Uma parte importante do processo de aprender Rust é aprender a ler as mensagens de erro exibidas pelo compilador: elas vão guiar você até um código que funciona. Por isso, forneceremos muitos exemplos que não compilam, junto com a mensagem de erro que o compilador mostrará em cada situação. Saiba que, se você digitar e executar um exemplo aleatório, ele pode não compilar! Leia sempre o texto ao redor para ver se o exemplo que você está tentando executar foi pensado para gerar erro. O Ferris também ajudará a diferenciar código que não foi feito para funcionar:

| Ferris | Significado |

|---|---|

| Este código não compila! | |

| Este código entra em pânico! | |

| Este código não produz o comportamento desejado. |

Na maioria das situações, vamos conduzir você até a versão correta de qualquer código que não compile.

Código-fonte

Os arquivos-fonte a partir dos quais este livro é gerado podem ser encontrados no GitHub.

Primeiros Passos

Vamos começar sua jornada com Rust! Há muito a aprender, mas toda jornada começa em algum lugar. Neste capítulo, vamos abordar:

- A instalação do Rust no Linux, no macOS e no Windows

- A escrita de um programa que imprime

Hello, world! - O uso do

cargo, o gerenciador de pacotes e sistema de build do Rust

Instalação

Instalação

O primeiro passo é instalar o Rust. Vamos baixar o Rust por meio do rustup,

uma ferramenta de linha de comando para gerenciar versões do Rust e

ferramentas associadas. Você precisará de uma conexão com a internet para o

download.

Nota: Se por algum motivo você preferir não usar

rustup, consulte a página Other Rust Installation Methods para ver outras opções.

Os passos a seguir instalam a versão estável mais recente do compilador Rust. As garantias de estabilidade do Rust asseguram que todos os exemplos do livro que compilam continuarão compilando em versões mais novas do Rust. A saída pode variar um pouco entre versões, porque Rust frequentemente melhora mensagens de erro e avisos. Em outras palavras, qualquer versão estável mais nova que você instalar seguindo estes passos deve funcionar como esperado com o conteúdo deste livro.

Notação de Linha de Comando

Neste capítulo e ao longo do livro, mostraremos alguns comandos usados no

terminal. Linhas que você deve digitar em um terminal sempre começam com

$. Você não precisa digitar o caractere $; ele é apenas o prompt de

comando, mostrado para indicar o início de cada comando. Linhas que não

começam com $ normalmente mostram a saída do comando anterior. Além disso,

exemplos específicos do PowerShell usarão > em vez de $.

Instalando o rustup no Linux ou no macOS

Se você estiver usando Linux ou macOS, abra um terminal e digite o seguinte comando:

$ curl --proto '=https' --tlsv1.2 https://sh.rustup.rs -sSf | sh

O comando baixa um script e inicia a instalação da ferramenta rustup, que

instala a versão estável mais recente do Rust. Você pode ser solicitado a

informar sua senha. Se a instalação for bem-sucedida, a seguinte linha

aparecerá:

Rust is installed now. Great!

Você também precisará de um linker, que é um programa que o Rust usa para juntar a saída compilada em um único arquivo. É provável que você já tenha um. Se receber erros de linker, deve instalar um compilador C, que normalmente já inclui um linker. Um compilador C também é útil porque alguns pacotes comuns do Rust dependem de código C e precisarão de um compilador desse tipo.

No macOS, você pode obter um compilador C executando:

$ xcode-select --install

Usuários de Linux normalmente devem instalar GCC ou Clang, de acordo com a

documentação de sua distribuição. Por exemplo, se você usa Ubuntu, pode

instalar o pacote build-essential.

Instalando o rustup no Windows

No Windows, acesse https://www.rust-lang.org/tools/install e siga as instruções de instalação do Rust. Em algum momento do processo, será solicitado que você instale o Visual Studio. Isso fornece um linker e as bibliotecas nativas necessárias para compilar programas. Se precisar de mais ajuda nessa etapa, veja https://rust-lang.github.io/rustup/installation/windows-msvc.html.

O restante deste livro usa comandos que funcionam tanto no cmd.exe quanto no PowerShell. Se houver diferenças específicas, explicaremos qual usar.

Solucionando problemas

Para verificar se o Rust foi instalado corretamente, abra um shell e execute a seguinte linha:

$ rustc --version

Você deverá ver o número da versão, o hash do commit e a data do commit da versão estável mais recente lançada, no seguinte formato:

rustc x.y.z (abcabcabc yyyy-mm-dd)

Se você vir essas informações, o Rust foi instalado com sucesso! Se não

aparecerem, verifique se o Rust está na variável de sistema %PATH%, assim:

No CMD do Windows, use:

> echo %PATH%

No PowerShell, use:

> echo $env:Path

No Linux e no macOS, use:

$ echo $PATH

Se isso estiver correto e o Rust ainda assim não funcionar, há vários lugares em que você pode conseguir ajuda. Descubra como entrar em contato com outros rustaceanos (um apelido brincalhão que usamos para nós mesmos) na página da comunidade.

Atualizando e desinstalando

Depois que o Rust estiver instalado via rustup, atualizar para uma versão

nova é simples. No shell, execute o seguinte script de atualização:

$ rustup update

Para desinstalar Rust e rustup, execute o seguinte script no shell:

$ rustup self uninstall

Lendo a documentação local

A instalação do Rust também inclui uma cópia local da documentação, para que

você possa lê-la offline. Execute rustup doc para abrir essa documentação no

seu navegador.

Sempre que um tipo ou função for fornecido pela biblioteca padrão e você não tiver certeza do que faz ou como usar, recorra à documentação da interface de programação de aplicações (API)!

Usando editores de texto e IDEs

Este livro não faz suposições sobre quais ferramentas você usa para escrever código Rust. Praticamente qualquer editor de texto dá conta do recado! Ainda assim, muitos editores de texto e ambientes de desenvolvimento integrados (IDEs) têm suporte embutido para Rust. Você sempre pode encontrar uma lista razoavelmente atualizada de vários editores e IDEs na página de ferramentas do site do Rust.

Trabalhando offline com este livro

Em vários exemplos, usaremos pacotes Rust além da biblioteca padrão. Para

acompanhar esses exemplos, você precisará ter conexão com a internet ou já ter

baixado essas dependências com antecedência. Para baixar as dependências antes,

você pode executar os comandos a seguir. Mais tarde explicaremos em detalhes o

que é cargo e o que cada um desses comandos faz.

$ cargo new get-dependencies

$ cd get-dependencies

$ cargo add rand@0.8.5 trpl@0.2.0

Isso fará cache dos downloads desses pacotes, então você não precisará

baixá-los depois. Depois de executar esse comando, você não precisa manter a

pasta get-dependencies. Se tiver executado esse comando, poderá usar a flag

--offline com todos os comandos cargo no restante do livro para utilizar

essas versões em cache em vez de tentar acessar a rede.

Olá, Mundo!

Olá, Mundo!

Agora que você instalou o Rust, chegou a hora de escrever seu primeiro

programa em Rust. É tradicional, ao aprender uma nova linguagem, escrever um

pequeno programa que imprima Hello, world! na tela, então faremos o mesmo

aqui.

Nota: Este livro presume familiaridade básica com a linha de comando. Rust não faz exigências específicas sobre edição, tooling ou o local onde seu código vive, então, se você preferir usar uma IDE em vez da linha de comando, fique à vontade para usar a sua favorita. Muitas IDEs já têm algum grau de suporte a Rust; consulte a documentação da sua IDE para detalhes. A equipe do Rust tem investido bastante em viabilizar um ótimo suporte a IDEs por meio do

rust-analyzer. Veja o Apêndice D para mais detalhes.

Configuração do diretório do projeto

Você começará criando um diretório para guardar seu código Rust. Para o Rust, não importa onde seu código fica, mas, para os exercícios e projetos deste livro, sugerimos criar um diretório projects dentro do seu diretório pessoal e manter todos os seus projetos lá.

Abra um terminal e digite os comandos a seguir para criar o diretório projects e, dentro dele, um diretório para o projeto “Hello, world!”.

No Linux, no macOS e no PowerShell do Windows, digite isto:

$ mkdir ~/projects

$ cd ~/projects

$ mkdir hello_world

$ cd hello_world

No CMD do Windows, digite isto:

> mkdir "%USERPROFILE%\projects"

> cd /d "%USERPROFILE%\projects"

> mkdir hello_world

> cd hello_world

Fundamentos de um programa Rust

Em seguida, crie um novo arquivo-fonte e chame-o de main.rs. Arquivos Rust sempre terminam com a extensão .rs. Se você estiver usando mais de uma palavra no nome do arquivo, a convenção é separá-las com underscore. Por exemplo, use hello_world.rs em vez de helloworld.rs.

Agora abra o arquivo main.rs que acabou de criar e digite o código da Listagem 1-1.

fn main() {

println!("Hello, world!");

}Hello, world!Salve o arquivo e volte para a janela do terminal no diretório ~/projects/hello_world. No Linux ou no macOS, digite os seguintes comandos para compilar e executar o arquivo:

$ rustc main.rs

$ ./main

Hello, world!

No Windows, use o comando .\main em vez de ./main:

> rustc main.rs

> .\main

Hello, world!

Independentemente do sistema operacional, a string Hello, world! deve ser

impressa no terminal. Se isso não acontecer, volte à parte

“Solucionando problemas” da seção de

instalação para ver formas de conseguir ajuda.

Se Hello, world! apareceu, parabéns! Você escreveu oficialmente um programa

em Rust. Isso faz de você um programador Rust: boas-vindas!

Anatomia de um programa Rust

Vamos revisar esse programa “Hello, world!” em detalhes. Aqui está a primeira peça do quebra-cabeça:

fn main() {

}Essas linhas definem uma função chamada main. A função main é especial:

ela é sempre o primeiro código executado em todo programa Rust executável.

Aqui, a primeira linha declara uma função chamada main que não recebe

parâmetros e não retorna nada. Se houvesse parâmetros, eles apareceriam dentro

dos parênteses (()).

O corpo da função fica entre {}. Rust exige chaves ao redor do corpo de todas

as funções. É considerado bom estilo colocar a chave de abertura na mesma linha

da declaração da função, com um espaço entre elas.

Nota: Se você quiser manter um estilo padrão entre projetos Rust, pode usar uma ferramenta de formatação automática chamada

rustfmtpara formatar seu código de um jeito específico. Falaremos mais sobrerustfmtno Apêndice D. A equipe do Rust inclui essa ferramenta na distribuição padrão do Rust, assim comorustc, então ela provavelmente já está instalada no seu computador!

O corpo da função main contém o seguinte código:

#![allow(unused)]

fn main() {

println!("Hello, world!");

}Essa linha faz todo o trabalho deste pequeno programa: ela imprime texto na tela. Há três detalhes importantes aqui.

Primeiro, println! chama uma macro do Rust. Se estivesse chamando uma função,

seria escrito como println sem o !. Macros em Rust são uma forma de

escrever código que gera código para estender a sintaxe da linguagem, e vamos

discuti-las com mais detalhes no Capítulo 20. Por

enquanto, basta saber que usar ! significa que você está chamando uma macro,

não uma função comum, e que macros nem sempre seguem as mesmas regras das

funções.

Segundo, você vê a string "Hello, world!". Passamos essa string como

argumento para println!, e ela é impressa na tela.

Terceiro, terminamos a linha com ponto e vírgula (;), o que indica que essa

expressão acabou e a próxima já pode começar. A maioria das linhas de código

Rust termina com ponto e vírgula.

Compilação e execução

Você acabou de executar um programa recém-criado, então vamos examinar cada etapa do processo.

Antes de executar um programa Rust, você precisa compilá-lo usando o compilador

Rust, digitando o comando rustc e passando o nome do arquivo-fonte, assim:

$ rustc main.rs

Se você tem experiência com C ou C++, perceberá que isso se parece com gcc

ou clang. Após uma compilação bem-sucedida, Rust gera um executável binário.

No Linux, no macOS e no PowerShell do Windows, você pode ver o executável

digitando o comando ls no shell:

$ ls

main main.rs

No Linux e no macOS, você verá dois arquivos. No PowerShell do Windows, verá os mesmos três arquivos que veria usando o CMD. No CMD do Windows, você digitaria o seguinte:

> dir /B %= a opção /B diz para mostrar apenas os nomes dos arquivos =%

main.exe

main.pdb

main.rs

Isso mostra o arquivo-fonte com a extensão .rs, o arquivo executável (main.exe no Windows, mas main nas demais plataformas) e, no Windows, um arquivo com informações de depuração com a extensão .pdb. A partir daí, você executa o arquivo main ou main.exe, assim:

$ ./main # ou .\main no Windows

Se o seu main.rs é o programa “Hello, world!”, essa linha imprimirá

Hello, world! no terminal.

Se você estiver mais acostumado a uma linguagem dinâmica, como Ruby, Python ou JavaScript, talvez não esteja acostumado a compilar e executar um programa como etapas separadas. Rust é uma linguagem compilada antecipadamente (ahead of time), o que significa que você pode compilar um programa e entregar o executável para outra pessoa, e ela poderá executá-lo mesmo sem ter Rust instalado. Se você entregar um arquivo .rb, .py ou .js, a pessoa precisará ter, respectivamente, uma implementação de Ruby, Python ou JavaScript instalada. Mas, nessas linguagens, normalmente basta um único comando para compilar e executar o programa. Tudo envolve trade-offs no design de linguagens.

Compilar apenas com rustc funciona bem para programas simples, mas, à medida

que o projeto cresce, você vai querer gerenciar todas as opções e facilitar o

compartilhamento do código. Em seguida, apresentaremos a ferramenta Cargo, que

ajudará você a escrever programas Rust do mundo real.

Olá, Cargo!

Olá, Cargo!

Cargo é o sistema de build e gerenciador de pacotes do Rust. A maioria dos rustaceanos usa essa ferramenta para gerenciar seus projetos Rust, porque Cargo cuida de muitas tarefas para você, como compilar seu código, baixar as bibliotecas das quais ele depende e compilar essas bibliotecas. Chamamos as bibliotecas de que seu código precisa de dependências.

Os programas mais simples em Rust, como o que escrevemos até agora, não têm dependências. Se tivéssemos criado o projeto “Hello, world!” com o Cargo, ele usaria apenas a parte do Cargo responsável por compilar seu código. Conforme você escrever programas Rust mais complexos, adicionará dependências e, se iniciar o projeto com Cargo, isso será muito mais fácil.

Como a vasta maioria dos projetos Rust usa Cargo, o restante deste livro pressupõe que você também o está usando. Cargo vem instalado com Rust se você usou os instaladores oficiais discutidos na seção “Instalação”. Se instalou o Rust de outra forma, verifique se o Cargo está instalado digitando o seguinte no terminal:

$ cargo --version

Se você vir um número de versão, então está tudo certo! Se vir um erro, como

command not found, consulte a documentação do seu método de instalação para

descobrir como instalar Cargo separadamente.

Criando um projeto com Cargo

Vamos criar um novo projeto usando Cargo e observar como ele difere do nosso projeto original “Hello, world!”. Volte para o diretório projects ou para o local onde decidiu guardar seu código. Em qualquer sistema operacional, execute o seguinte:

$ cargo new hello_cargo

$ cd hello_cargo

O primeiro comando cria um novo diretório e projeto chamados hello_cargo. Demos ao projeto o nome hello_cargo, e o Cargo cria seus arquivos em um diretório com esse mesmo nome.

Entre no diretório hello_cargo e liste os arquivos. Você verá que o Cargo gerou dois arquivos e um diretório para nós: um arquivo Cargo.toml e um diretório src com um arquivo main.rs dentro dele.

Ele também inicializou um novo repositório Git junto com um arquivo

.gitignore. Os arquivos do Git não serão gerados se você executar

cargo new dentro de um repositório Git já existente; você pode mudar esse

comportamento usando cargo new --vcs=git.

Nota: Git é um sistema de controle de versão bastante comum. Você pode mudar

cargo newpara usar outro sistema de controle de versão ou nenhum, usando a flag--vcs. Executecargo new --helppara ver as opções disponíveis.

Abra Cargo.toml no editor de texto de sua preferência. Ele deve se parecer com o código da Listagem 1-2.

[package]

name = "hello_cargo"

version = "0.1.0"

edition = "2024"

[dependencies]

cargo newEsse arquivo está no formato TOML (Tom’s Obvious, Minimal Language), que é o formato de configuração do Cargo.

A primeira linha, [package], é um cabeçalho de seção que indica que as

declarações seguintes configuram um package. À medida que adicionarmos mais

informações a esse arquivo, acrescentaremos outras seções.

As três linhas seguintes definem as informações de configuração de que o Cargo

precisa para compilar seu programa: o nome, a versão e a edição do Rust a ser

usada. Falaremos sobre a chave edition no Apêndice E.

A última linha, [dependencies], marca o começo de uma seção na qual você

listará as dependências do projeto. Em Rust, pacotes de código são chamados de

crates. Não precisaremos de outros crates para este projeto, mas

precisaremos no primeiro projeto do Capítulo 2, então usaremos essa seção

naquela ocasião.

Agora abra src/main.rs e dê uma olhada:

Nome do arquivo: src/main.rs

fn main() {

println!("Hello, world!");

}O Cargo gerou para você um programa “Hello, world!”, exatamente como o que escrevemos na Listagem 1-1! Até aqui, as diferenças entre o nosso projeto e o projeto gerado pelo Cargo são que o Cargo colocou o código dentro do diretório src e criou um arquivo de configuração Cargo.toml no diretório superior.

O Cargo espera que seus arquivos-fonte fiquem dentro do diretório src. O diretório de topo do projeto deve conter apenas arquivos README, informações de licença, arquivos de configuração e qualquer outra coisa que não esteja diretamente relacionada ao código. Usar Cargo ajuda a organizar seus projetos. Há um lugar para cada coisa, e cada coisa fica em seu lugar.

Se você iniciou um projeto sem usar Cargo, como fizemos com o projeto “Hello,

world!”, pode convertê-lo para um projeto que use Cargo. Mova o código do

projeto para o diretório src e crie um arquivo Cargo.toml adequado. Uma

forma simples de obter esse arquivo Cargo.toml é executar cargo init, que o

criará automaticamente para você.

Compilando e executando um projeto Cargo

Agora vamos ver o que muda quando compilamos e executamos o programa “Hello, world!” com Cargo! No diretório hello_cargo, compile o projeto digitando:

$ cargo build

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 2.85 secs

Esse comando cria um executável em target/debug/hello_cargo ou target\debug\hello_cargo.exe no Windows, em vez de gerá-lo no diretório atual. Como o build padrão é de depuração, o Cargo coloca o binário em um diretório chamado debug. Você pode executar o executável com este comando:

$ ./target/debug/hello_cargo # ou .\target\debug\hello_cargo.exe no Windows

Hello, world!

Se tudo correr bem, Hello, world! deve ser impresso no terminal. Executar

cargo build pela primeira vez também faz o Cargo criar um novo arquivo no

nível superior do projeto: Cargo.lock. Esse arquivo mantém registro das

versões exatas das dependências do projeto. Como este projeto não tem

dependências, o arquivo é bem enxuto. Você nunca precisará alterá-lo

manualmente; o Cargo gerencia seu conteúdo para você.

Acabamos de compilar um projeto com cargo build e executá-lo com

./target/debug/hello_cargo, mas também podemos usar cargo run para compilar

o código e depois executar o binário resultante em um único comando:

$ cargo run

Finished dev [unoptimized + debuginfo] target(s) in 0.0 secs

Running `target/debug/hello_cargo`

Hello, world!

Usar cargo run é mais conveniente do que lembrar de executar cargo build e

depois usar o caminho completo até o binário, então a maioria dos

desenvolvedores prefere cargo run.

Observe que, desta vez, não vimos a saída indicando que o Cargo estava

compilando hello_cargo. O Cargo percebeu que os arquivos não haviam mudado,

então ele não recompilou nada; apenas executou o binário. Se você tivesse

modificado o código-fonte, o Cargo recompilaria o projeto antes de executá-lo,

e você veria esta saída:

$ cargo run

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.33 secs

Running `target/debug/hello_cargo`

Hello, world!

O Cargo também oferece um comando chamado cargo check. Esse comando verifica

rapidamente se seu código compila, mas não produz um executável:

$ cargo check

Checking hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.32 secs

Por que você não iria querer um executável? Muitas vezes, cargo check é bem

mais rápido do que cargo build, porque pula a etapa de gerar o executável. Se

você estiver checando seu trabalho continuamente enquanto escreve código, usar

cargo check acelera o processo de descobrir se o projeto ainda está

compilando! Por isso, muitos rustaceanos executam cargo check

periodicamente enquanto escrevem seus programas, para garantir que tudo

continua compilando. Depois, quando estão prontos para usar o executável,

executam cargo build.

Vamos recapitular o que aprendemos até aqui sobre Cargo:

- Podemos criar um projeto usando

cargo new. - Podemos compilar um projeto usando

cargo build. - Podemos compilar e executar um projeto em uma única etapa usando

cargo run. - Podemos verificar se há erros em um projeto sem produzir um binário usando

cargo check. - Em vez de salvar o resultado do build no mesmo diretório do código, o Cargo o armazena no diretório target/debug.

Uma vantagem adicional do Cargo é que os comandos são os mesmos independentemente do sistema operacional em que você está trabalhando. Por isso, a partir deste ponto, deixaremos de fornecer instruções separadas para Linux e macOS versus Windows.

Compilando para release

Quando o projeto finalmente estiver pronto para release, você pode usar

cargo build --release para compilá-lo com otimizações. Esse comando criará um

executável em target/release em vez de target/debug. As otimizações fazem o

código Rust rodar mais rápido, mas ativá-las aumenta o tempo de compilação.

Por isso há dois perfis diferentes: um para desenvolvimento, quando você quer

recompilar rapidamente e com frequência, e outro para gerar o programa final

que será entregue ao usuário, que não será recompilado repetidamente e deverá

executar o mais rápido possível. Se você estiver medindo o tempo de execução do

seu código, lembre-se de rodar cargo build --release e fazer o benchmark com

o executável em target/release.

Aproveitando as convenções do Cargo

Em projetos simples, o Cargo não oferece muito mais valor do que usar rustc

diretamente, mas ele mostra seu valor à medida que os programas ficam mais

complexos. Quando um programa cresce para múltiplos arquivos ou passa a precisar

de dependências, é muito mais fácil deixar o Cargo coordenar o build.

Mesmo sendo simples, o projeto hello_cargo já usa grande parte do ferramental

real que você vai utilizar no restante da sua carreira com Rust. Na prática,

para trabalhar em qualquer projeto existente, você pode usar os comandos a

seguir para baixar o código com Git, entrar no diretório do projeto e compilar:

$ git clone example.org/someproject

$ cd someproject

$ cargo build

Para mais informações sobre Cargo, consulte sua documentação.

Resumo

Você já começou muito bem sua jornada com Rust! Neste capítulo, você aprendeu a:

- Instalar a versão estável mais recente do Rust usando

rustup. - Atualizar para uma versão mais nova do Rust.

- Abrir a documentação instalada localmente.

- Escrever e executar um programa “Hello, world!” usando

rustcdiretamente. - Criar e executar um novo projeto usando as convenções do Cargo.

Este é um ótimo momento para construir um programa mais substancial e se acostumar a ler e escrever código Rust. Então, no Capítulo 2, construiremos um programa de jogo de adivinhação. Se preferir começar entendendo como conceitos comuns de programação funcionam em Rust, veja o Capítulo 3 e depois volte ao Capítulo 2.

Programando um Jogo de Adivinhação

Vamos entrar no Rust trabalhando juntos em um projeto prático! Este capítulo

apresenta alguns conceitos comuns da linguagem ao mostrar como usá-los em um

programa real. Você aprenderá sobre let, match, métodos, funções

associadas, crates externos e muito mais. Nos capítulos seguintes,

exploraremos essas ideias em mais detalhes. Aqui, o objetivo é praticar os

fundamentos.

Implementaremos um problema clássico para iniciantes: um jogo de adivinhação. O funcionamento é simples: o programa gera um número inteiro aleatório entre 1 e 100 e pede que a pessoa jogadora digite um palpite. Depois que o palpite é informado, o programa diz se ele é baixo demais ou alto demais. Se o palpite estiver correto, o jogo imprime uma mensagem de parabéns e encerra.

Configurando um Novo Projeto

Para configurar um novo projeto, vá até o diretório projects que você criou no Capítulo 1 e crie um novo projeto com o Cargo:

$ cargo new guessing_game

$ cd guessing_game

O primeiro comando, cargo new, recebe o nome do projeto

(guessing_game) como primeiro argumento. O segundo comando entra no diretório

do projeto recém-criado.

Veja o arquivo Cargo.toml gerado:

Nome do arquivo: Cargo.toml

[package]

name = "guessing_game"

version = "0.1.0"

edition = "2024"

[dependencies]

Como você viu no Capítulo 1, cargo new gera para você um programa “Hello,

world!”. Veja o arquivo src/main.rs:

Nome do arquivo: src/main.rs

fn main() {

println!("Hello, world!");

}Agora vamos compilar esse programa “Hello, world!” e executá-lo em uma única

etapa usando o comando cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.08s

Running `target/debug/guessing_game`

Hello, world!

O comando run é útil quando você precisa iterar rapidamente em um projeto,

como faremos neste jogo, testando cada alteração antes de seguir adiante.

Abra novamente o arquivo src/main.rs. Você escreverá todo o código neste arquivo.

Processando um Palpite

A primeira parte do programa do jogo de adivinhação vai pedir uma entrada ao usuário, processá-la e verificar se ela está no formato esperado. Para começar, vamos permitir que a pessoa jogadora digite um palpite. Insira o código da Listagem 2-1 em src/main.rs.

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Esse código contém muita coisa, então vamos analisá-lo linha por linha. Para

receber a entrada do usuário e depois imprimir o resultado, precisamos trazer

para o escopo a biblioteca de entrada e saída io. A biblioteca io faz

parte da biblioteca padrão, conhecida como std:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Por padrão, Rust traz para o escopo de todo programa um conjunto de itens definidos na biblioteca padrão. Esse conjunto é chamado de prelude, e você pode ver tudo o que ele inclui na documentação da biblioteca padrão.

Se um tipo que você quer usar não estiver no prelude, será necessário trazê-lo

explicitamente para o escopo com uma instrução use. A biblioteca std::io

fornece vários recursos úteis, incluindo a capacidade de ler entrada do

usuário.

Como você viu no Capítulo 1, a função main é o ponto de entrada no

programa:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}A sintaxe fn declara uma nova função; os parênteses () indicam que não há

parâmetros; e a chave { inicia o corpo da função.

Como você também aprendeu no Capítulo 1, println! é uma macro que imprime uma

string na tela:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Esse código imprime uma mensagem informando sobre o jogo e pedindo a entrada do usuário.

Armazenando Valores com Variáveis

A seguir, criaremos uma variável para armazenar a entrada do usuário, assim:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Agora o programa começa a ficar interessante! Há bastante coisa acontecendo

nessa linha curta. Usamos a instrução let para criar a variável. Aqui vai

outro exemplo:

let apples = 5;Esta linha cria uma nova variável chamada apples e a vincula ao valor 5.

Em Rust, variáveis são imutáveis por padrão; isto é, depois que damos um valor

a uma variável, esse valor não muda. Discutiremos esse conceito em detalhes na

seção “Variáveis e Mutabilidade” do

Capítulo 3. Para tornar uma variável mutável, adicionamos mut antes do nome

da variável:

let apples = 5; // immutable

let mut bananas = 5; // mutableNota: a sintaxe

//inicia um comentário que vai até o fim da linha. Rust ignora tudo o que estiver em comentários. Falaremos mais sobre comentários no Capítulo 3.

Voltando ao programa do jogo de adivinhação, agora você sabe que let mut guess vai introduzir uma variável mutável chamada guess. O sinal de igual

(=) diz ao Rust que queremos associar algo à variável naquele momento. À

direita do sinal de igual está o valor ao qual guess será associado, que é o

resultado da chamada String::new, uma função que retorna uma nova instância

de String. String é um tipo de string fornecido

pela biblioteca padrão; trata-se de um pedaço de texto codificado em UTF-8 que

pode crescer.

A sintaxe :: em String::new indica que new é uma função associada ao

tipo String. Uma função associada é uma função implementada em um tipo,

neste caso String. A função new cria uma string nova e vazia. Você verá

uma função new em vários tipos porque esse é um nome comum para uma função

que cria algum valor novo.

Portanto, a linha let mut guess = String::new(); cria uma variável mutável

que está associada, naquele momento, a uma instância nova e vazia de String.

Recebendo entrada do usuário

Lembre-se de que incluímos a funcionalidade de entrada e saída da biblioteca

padrão com use std::io; na primeira linha do programa. Agora vamos chamar a

função stdin do módulo io, que nos permitirá lidar com a entrada do

usuário:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Se não tivéssemos importado o módulo io com use std::io; no início do

programa, ainda poderíamos usar a função escrevendo a chamada como

std::io::stdin. A função stdin retorna uma instância de

std::io::Stdin, um tipo que representa um

manipulador para a entrada padrão do seu terminal.

Em seguida, a linha .read_line(&mut guess) chama o método

read_line nesse manipulador de entrada padrão

para obter a entrada do usuário. Também passamos &mut guess como argumento

para read_line, indicando em qual string a entrada deverá ser armazenada. O

comportamento de read_line é pegar tudo o que o usuário digita na entrada

padrão e anexar esse conteúdo à string passada como argumento, sem sobrescrever

o que ela já contém. Por isso, o argumento precisa ser mutável: o método vai

alterar o conteúdo da string.

O & indica que esse argumento é uma referência, o que dá a você uma forma

de permitir que várias partes do código acessem um mesmo dado sem precisar

copiá-lo na memória muitas vezes. Referências são um recurso complexo, e uma

das grandes vantagens do Rust é que ele torna o uso delas seguro e prático.

Você não precisa entender todos esses detalhes agora para terminar este

programa. Por enquanto, basta saber que, assim como variáveis, referências são

imutáveis por padrão. Por isso, você precisa escrever &mut guess em vez de

&guess para torná-la mutável. O Capítulo 4 explicará referências com mais

detalhes.

Lidando com falhas potenciais com Result

Ainda estamos trabalhando nessa linha de código. Agora estamos discutindo uma terceira linha de texto, mas observe que ela ainda faz parte de uma única linha lógica de código. A próxima parte é este método:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Poderíamos ter escrito este código como:

io::stdin().read_line(&mut guess).expect("Failed to read line");No entanto, uma linha longa é difícil de ler, por isso é melhor dividi-la.

Muitas vezes, vale a pena introduzir uma quebra de linha e outros espaços em

branco para separar linhas longas quando você chama um método com a sintaxe

.method_name(). Agora vamos discutir o que essa linha faz.

Como mencionamos antes, read_line coloca tudo o que a pessoa usuária digita

na string que passamos a ele, mas também retorna um valor Result.

Result é uma enumeração,

geralmente chamada de enum, que é um tipo que pode estar em um dentre vários

estados possíveis. Chamamos cada estado possível de variante.

Capítulo 6 abordará enums em mais detalhes. O propósito

de tipos Result é codificar informações sobre tratamento de erros.

As variantes de Result são Ok e Err. A variante Ok indica que a

operação foi bem-sucedida e contém o valor gerado com sucesso. A variante

Err significa que a operação falhou e contém informações sobre como ou por

que ela falhou.

Valores do tipo Result, como valores de qualquer outro tipo, têm métodos

definidos neles. Uma instância de Result tem um método

expect que você pode chamar. Se essa instância de

Result for um valor Err, expect fará o programa encerrar e exibirá a

mensagem que você passou como argumento para expect. Se o método read_line

retornar um Err, isso provavelmente será resultado de um erro vindo do

sistema operacional subjacente. Se essa instância de Result for um valor

Ok, expect pegará o valor que Ok está contendo e o retornará para você

usar. Nesse caso, esse valor é o número de bytes da entrada da pessoa usuária.

Se você não chamar expect, o programa será compilado, mas você receberá um aviso:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

warning: unused `Result` that must be used

--> src/main.rs:10:5

|

10 | io::stdin().read_line(&mut guess);

| ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

|

= note: this `Result` may be an `Err` variant, which should be handled

= note: `#[warn(unused_must_use)]` on by default

help: use `let _ = ...` to ignore the resulting value

|

10 | let _ = io::stdin().read_line(&mut guess);

| +++++++

warning: `guessing_game` (bin "guessing_game") generated 1 warning

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.59s

Rust avisa que você não usou o valor Result retornado de read_line,

indicando que o programa não tratou um possível erro.

A forma correta de suprimir o aviso é escrever código de tratamento de erros,

mas, no nosso caso, queremos apenas encerrar o programa quando ocorrer um

problema, então podemos usar expect. Você aprenderá como se recuperar de

erros no Capítulo 9.

Imprimindo valores com placeholders de println!

Além da chave de fechamento, há apenas mais uma linha para discutir no código até aqui:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Essa linha imprime a string que agora contém a entrada da pessoa usuária. O

conjunto {} de chaves funciona como um placeholder: pense em {} como

pequenas garras de caranguejo segurando um valor no lugar. Ao imprimir o valor

de uma variável, o nome da variável pode ir entre as chaves. Ao imprimir o

resultado da avaliação de uma expressão, coloque chaves vazias na string de

formatação e, em seguida, acrescente à string de formatação uma lista de

expressões separadas por vírgula, a serem impressas em cada placeholder vazio,

na mesma ordem. Imprimir uma variável e o resultado de uma expressão em uma

única chamada a println! ficaria assim:

#![allow(unused)]

fn main() {

let x = 5;

let y = 10;

println!("x = {x} and y + 2 = {}", y + 2);

}Esse código imprimiria x = 5 and y + 2 = 12.

Testando a primeira parte

Vamos testar a primeira parte do jogo de adivinhação. Execute-o usando cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 6.44s

Running `target/debug/guessing_game`

Guess the number!

Please input your guess.

6

You guessed: 6

Neste ponto, a primeira parte do jogo está concluída: estamos recebendo entrada do teclado e depois imprimindo essa entrada.

Gerando um número secreto

A seguir, precisamos gerar um número secreto que a pessoa usuária tentará

adivinhar. O número secreto deve ser diferente a cada vez para que o jogo seja

divertido de jogar mais de uma vez. Vamos usar um número aleatório entre 1 e

100 para que o jogo não fique muito difícil. Rust ainda não inclui

funcionalidade de números aleatórios em sua biblioteca padrão. No entanto, a

equipe do Rust fornece uma crate chamada rand com essa

funcionalidade.

Aumentando a funcionalidade com uma crate

Lembre-se de que uma crate é uma coleção de arquivos de código-fonte Rust. O

projeto que estamos construindo é uma crate binária, isto é, um executável. A

crate rand é uma crate de biblioteca, que contém código destinado a ser

usado em outros programas e não pode ser executado sozinha.

A forma como o Cargo coordena crates externas é onde ele realmente brilha.

Antes de escrevermos código que use rand, precisamos modificar o arquivo

Cargo.toml para incluir a crate rand como dependência. Abra esse arquivo

agora e adicione a linha a seguir no final, abaixo do cabeçalho da seção

[dependencies] que o Cargo criou para você. Certifique-se de especificar

rand exatamente como está aqui, com esse número de versão, ou os exemplos de

código deste tutorial podem não funcionar:

Nome do arquivo: Cargo.toml

[dependencies]

rand = "0.8.5"

No arquivo Cargo.toml, tudo o que vem depois de um cabeçalho faz parte

daquela seção, até que outra seção comece. Em [dependencies], você informa ao

Cargo de quais crates externas o projeto depende e de quais versões dessas

crates você precisa. Neste caso, especificamos a crate rand com o

especificador de versão semântica 0.8.5. O Cargo entende Versionamento

Semântico, às vezes chamado de SemVer, que é um

padrão para escrever números de versão. O especificador 0.8.5 é, na verdade,

uma abreviação de ^0.8.5, o que significa qualquer versão que seja pelo menos

0.8.5, mas abaixo de 0.9.0.

O Cargo considera que essas versões têm APIs públicas compatíveis com a versão 0.8.5, e essa especificação garante que você obterá a versão de patch mais recente que ainda compilará com o código deste capítulo. Não há garantia de que qualquer versão 0.9.0 ou superior tenha a mesma API usada nos exemplos a seguir.

Agora, sem alterar nenhum código, vamos compilar o projeto, como mostra a Listagem 2-2.

$ cargo build

Updating crates.io index

Locking 15 packages to latest Rust 1.85.0 compatible versions

Adding rand v0.8.5 (available: v0.9.0)

Compiling proc-macro2 v1.0.93

Compiling unicode-ident v1.0.17

Compiling libc v0.2.170

Compiling cfg-if v1.0.0

Compiling byteorder v1.5.0

Compiling getrandom v0.2.15

Compiling rand_core v0.6.4

Compiling quote v1.0.38

Compiling syn v2.0.98

Compiling zerocopy-derive v0.7.35

Compiling zerocopy v0.7.35

Compiling ppv-lite86 v0.2.20

Compiling rand_chacha v0.3.1

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 2.48s

cargo build após adicionar a crate rand como dependênciaVocê pode ver números de versão diferentes, embora todos sejam compatíveis com o código graças ao SemVer, e linhas diferentes, dependendo do sistema operacional. As linhas também podem aparecer em outra ordem.

Quando incluímos uma dependência externa, o Cargo busca no registry as versões mais recentes de tudo de que a dependência precisa. O registry é uma cópia dos dados de Crates.io. O Crates.io é onde as pessoas do ecossistema Rust publicam seus projetos Rust de código aberto para que outras pessoas possam usá-los.

Depois de atualizar o registry, o Cargo verifica a seção [dependencies] e

baixa todas as crates listadas que ainda não foram baixadas. Nesse caso,

embora tenhamos listado apenas rand como dependência, o Cargo também obteve

outras crates das quais rand depende para funcionar. Depois de baixar as

crates, Rust as compila e, em seguida, compila o projeto com as dependências

disponíveis.

Se você executar cargo build imediatamente de novo, sem fazer nenhuma

alteração, não verá nenhuma saída além da linha Finished. O Cargo sabe que

já baixou e compilou as dependências e que você não mudou nada nelas no arquivo

Cargo.toml. Ele também sabe que você não mudou nada no seu código, então não

o recompila. Sem nada a fazer, ele simplesmente encerra.

Se você abrir o arquivo src/main.rs, fizer uma alteração trivial, salvá-lo e compilar novamente, verá apenas duas linhas de saída:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.13s

Essas linhas mostram que o Cargo atualiza apenas o build com a pequena mudança feita no arquivo src/main.rs. Como as dependências não mudaram, o Cargo sabe que pode reutilizar o que já foi baixado e compilado para elas.

Garantindo builds reproduzíveis

O Cargo tem um mecanismo que garante que você possa recriar o mesmo artefato

toda vez que você ou qualquer outra pessoa compilar o código: ele usará apenas

as versões das dependências que você especificou até que você diga o contrário.

Por exemplo, imagine que, na próxima semana, a versão 0.8.6 da crate rand

seja lançada, contendo uma correção de bug importante, mas também uma regressão

que quebrará seu código. Para lidar com isso, Rust cria o arquivo

Cargo.lock na primeira vez que você executa cargo build, então agora temos

esse arquivo no diretório guessing_game.

Quando você compila um projeto pela primeira vez, o Cargo descobre todas as versões das dependências que atendem aos critérios e depois as grava no arquivo Cargo.lock. Quando você compilar o projeto no futuro, o Cargo verá que o arquivo Cargo.lock existe e usará as versões especificadas ali, em vez de repetir todo o trabalho de descobrir as versões novamente. Isso permite que você tenha um build reproduzível automaticamente. Em outras palavras, o seu projeto permanecerá na versão 0.8.5 até que você atualize explicitamente, graças ao arquivo Cargo.lock. Como esse arquivo é importante para builds reproduzíveis, muitas vezes ele é versionado junto com o restante do código no projeto.

Atualizando uma crate para obter uma nova versão

Quando você quiser atualizar uma crate, o Cargo fornece o comando update,

que ignorará o arquivo Cargo.lock e descobrirá todas as versões mais recentes

que atendem às especificações do seu Cargo.toml. O Cargo então escreverá

essas versões no arquivo Cargo.lock. Fora isso, por padrão, o Cargo procurará

apenas versões maiores que 0.8.5 e menores que 0.9.0. Se a crate rand

tivesse lançado as duas novas versões 0.8.6 e 0.999.0, você veria o seguinte

ao executar cargo update:

Há muito mais a dizer sobre Cargo e seu ecossistema, que discutiremos no Capítulo 14, mas, por enquanto, isso é tudo o que você precisa saber. O Cargo facilita muito a reutilização de bibliotecas, então os rustaceanos conseguem escrever projetos menores, montados a partir de vários pacotes.

Gerando um número aleatório

Vamos começar a usar rand para gerar um número a ser adivinhado. O próximo

passo é atualizar src/main.rs, como mostra a Listagem 2-3.

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Primeiro, adicionamos a linha use rand::Rng;. A trait Rng define métodos

que geradores de números aleatórios implementam, e essa trait precisa estar em

escopo para que possamos usar esses métodos. O Capítulo 10 abordará traits em

detalhes.

A seguir, estamos adicionando duas linhas no meio. Na primeira, chamamos a

função rand::thread_rng, que nos fornece o gerador de números aleatórios

específico que vamos usar: um que é local à thread de execução atual e é

inicializado pelo sistema operacional. Depois, chamamos o método gen_range

nesse gerador de números aleatórios. Esse método é definido pela trait Rng

que trouxemos para o escopo com a instrução use rand::Rng;. O método

gen_range recebe uma expressão de intervalo como argumento e gera um número

aleatório dentro desse intervalo. O tipo de expressão de intervalo que estamos

usando aqui tem a forma start..=end e inclui os limites inferior e superior;

por isso, precisamos especificar 1..=100 para pedir um número entre 1 e 100.

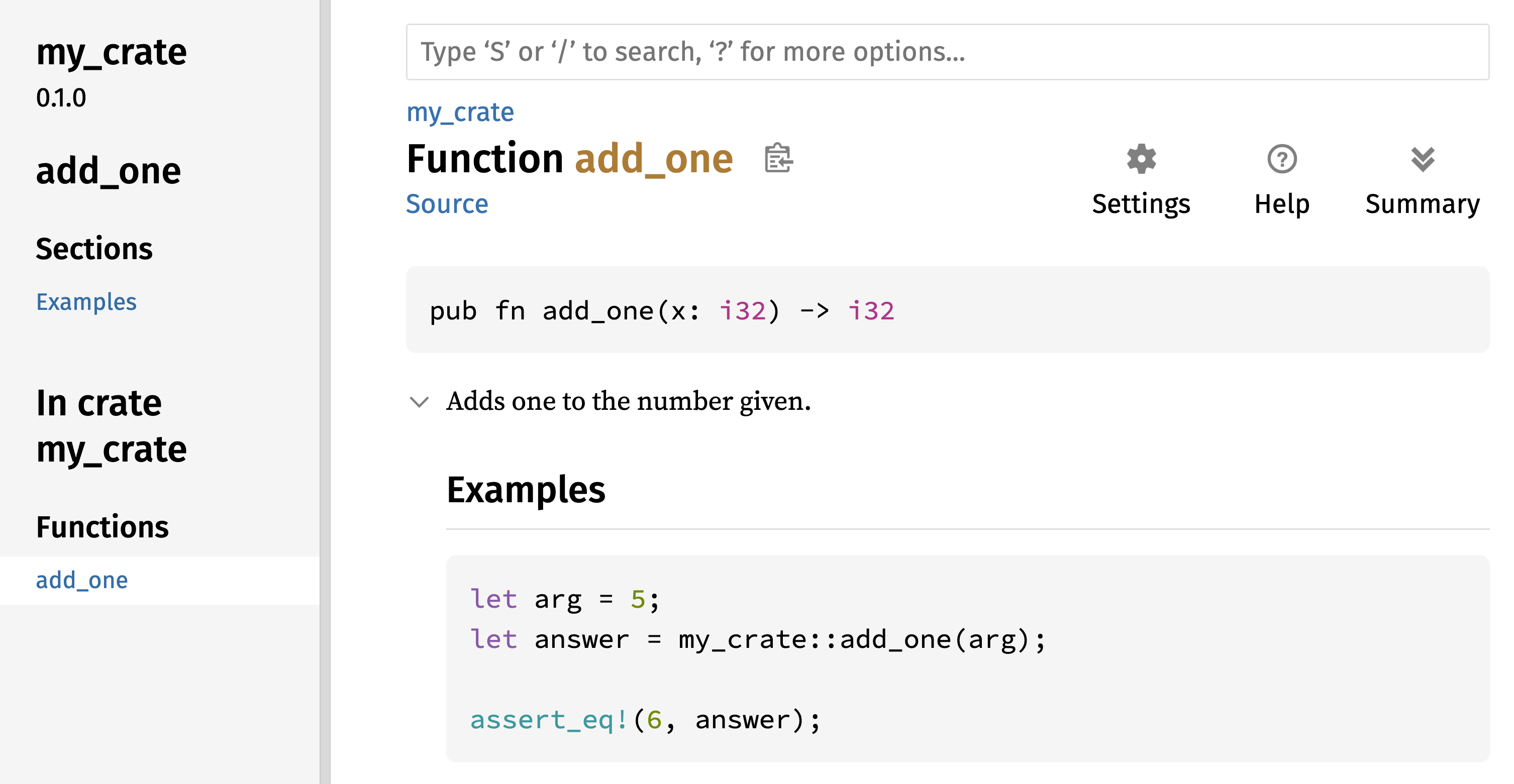

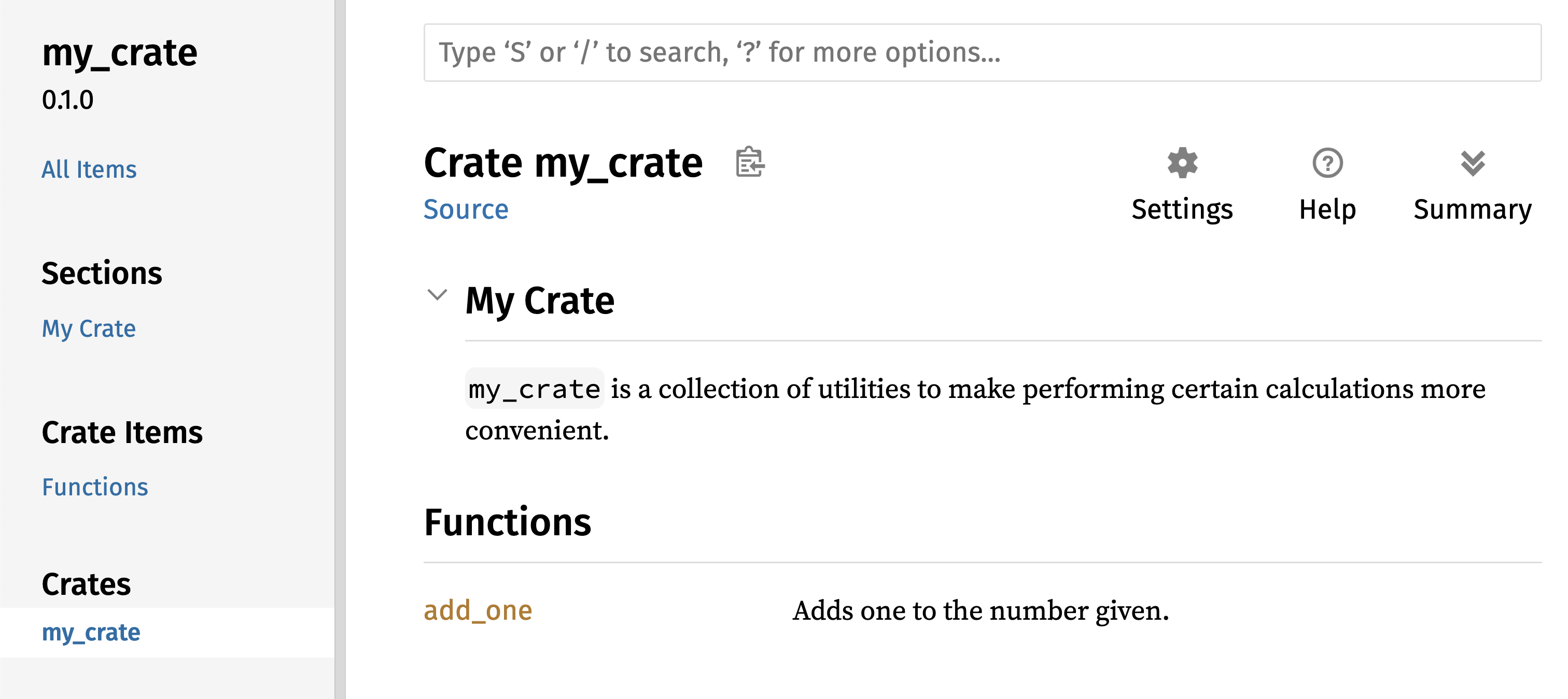

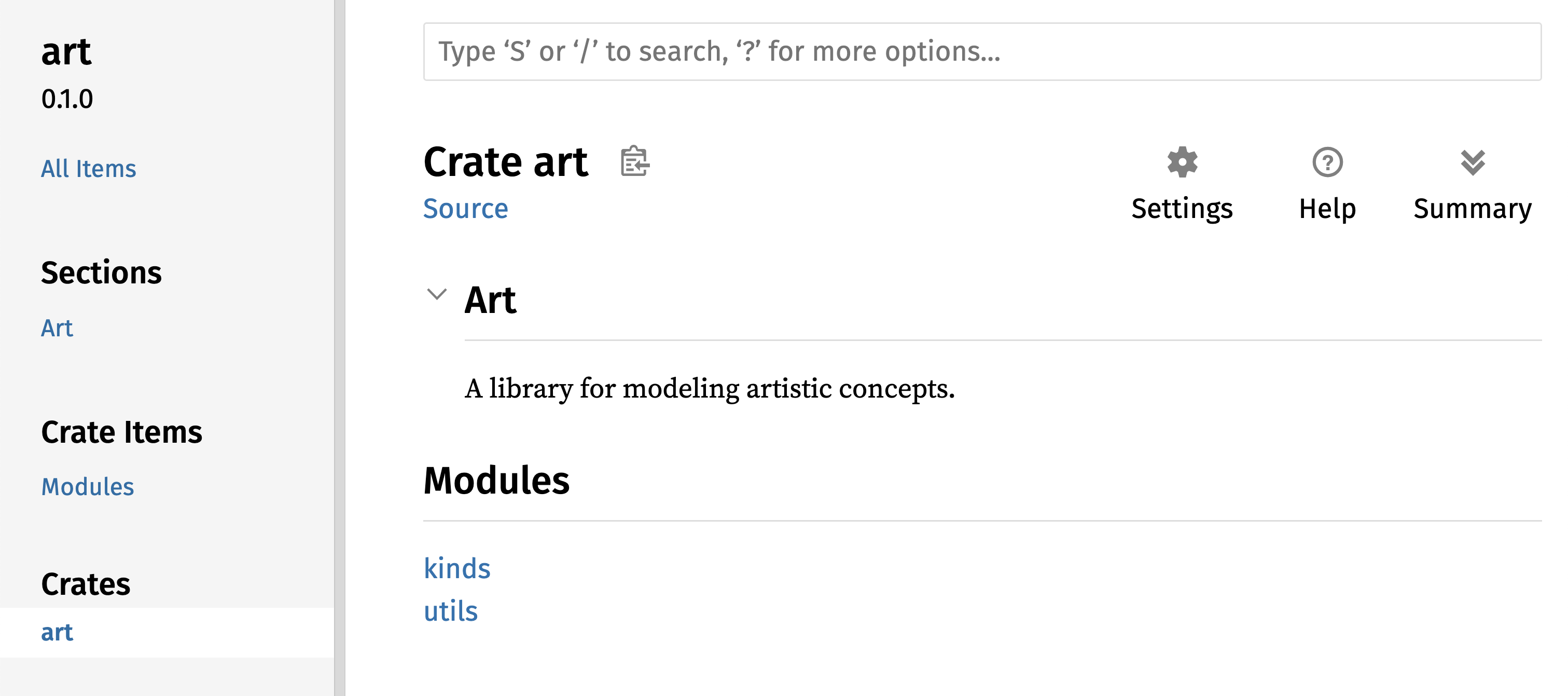

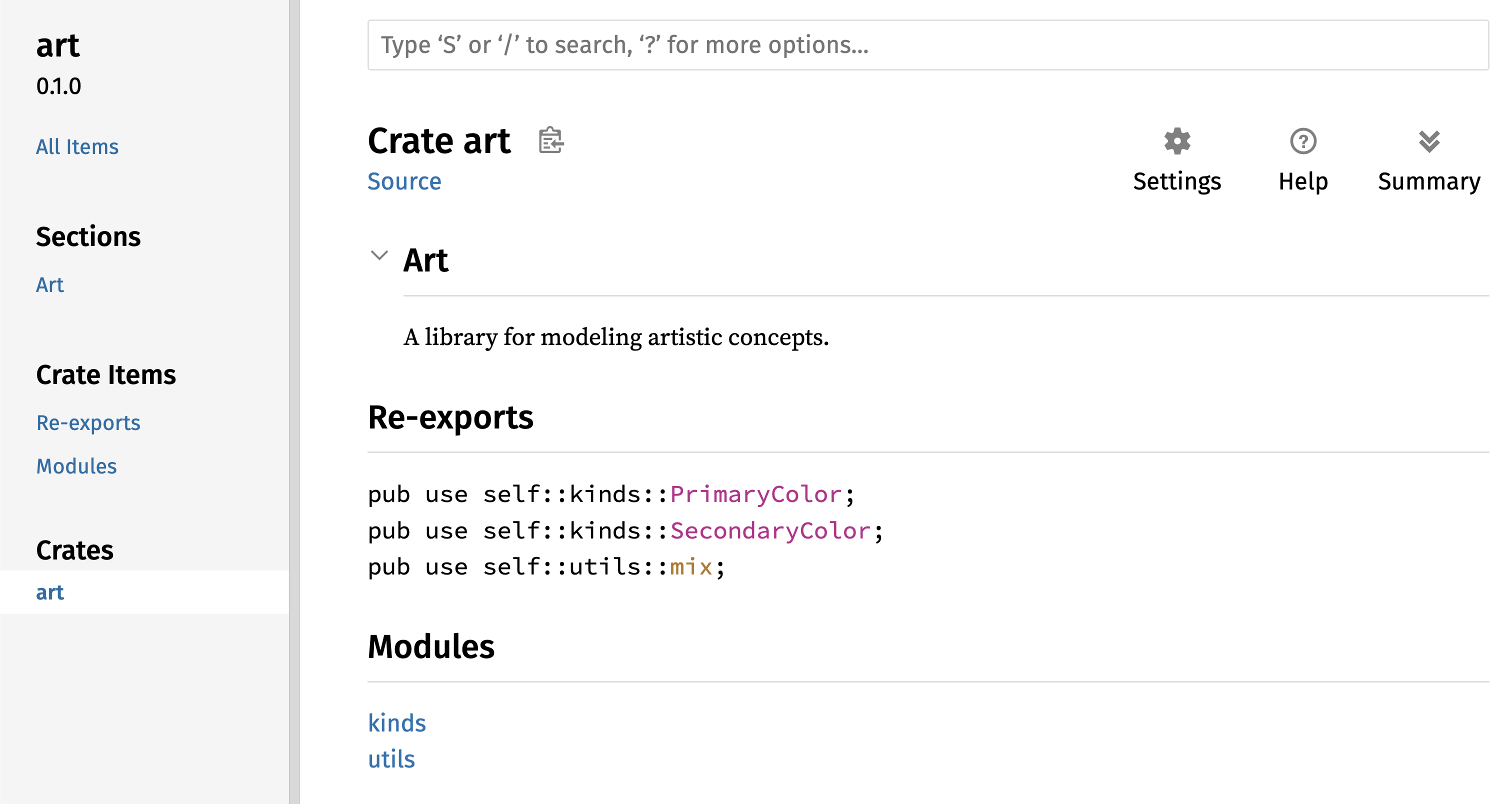

Nota: você não vai simplesmente saber quais traits usar e quais métodos e funções chamar de uma crate, então cada crate tem documentação com instruções sobre como usá-la. Outro recurso interessante do Cargo é que executar o comando

cargo doc --opencompila localmente a documentação fornecida por todas as suas dependências e a abre no navegador. Se você tiver interesse em outras funcionalidades da craterand, por exemplo, executecargo doc --opene clique emrandna barra lateral à esquerda.

A segunda nova linha imprime o número secreto. Isso é útil enquanto estamos desenvolvendo o programa para podermos testá-lo, mas vamos removê-la da versão final. Não existe muita graça em um jogo que imprime a resposta assim que começa!

Tente executar o programa algumas vezes:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.02s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 7

Please input your guess.

4

You guessed: 4

$ cargo run

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.02s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 83

Please input your guess.

5

You guessed: 5

Você deve obter números aleatórios diferentes, e todos eles devem estar entre 1 e 100. Ótimo trabalho!

Comparando o Palpite com o Número Secreto

Agora que temos a entrada da pessoa usuária e um número aleatório, podemos compará-los. Esse passo é mostrado na Listagem 2-4. Observe que esse código ainda não compilará, como explicaremos.

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

// --snip--

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}Primeiro, adicionamos outra instrução use, trazendo para o escopo um tipo da

biblioteca padrão chamado std::cmp::Ordering. O tipo Ordering é outro enum

e tem as variantes Less, Greater e Equal. Esses são os três resultados

possíveis ao comparar dois valores.

Em seguida, adicionamos cinco novas linhas na parte inferior que usam o tipo

Ordering. O método cmp compara dois valores e pode ser chamado em qualquer

coisa que possa ser comparada. Ele recebe uma referência ao que você quer

comparar com o valor atual; aqui, ele está comparando guess com

secret_number. Depois, retorna uma variante do enum Ordering que trouxemos

para o escopo com a instrução use. Usamos uma expressão

match para decidir o que fazer a seguir com base em

qual variante de Ordering foi retornada pela chamada a cmp com os valores

em guess e secret_number.

Uma expressão match é composta por braços. Um braço consiste em um

padrão a ser comparado e no código que deve ser executado se o valor dado a

match se encaixar no padrão daquele braço. Rust pega o valor fornecido a

match e verifica, em sequência, o padrão de cada braço. Padrões e a

construção match são recursos poderosos do Rust: eles permitem expressar uma

grande variedade de situações que seu código pode encontrar e garantem que

você trate todas elas. Esses recursos serão abordados em detalhes no Capítulo

6 e no Capítulo 19, respectivamente.

Vamos percorrer um exemplo com a expressão match que usamos aqui. Digamos que

a pessoa usuária tenha chutado 50 e que o número secreto gerado aleatoriamente

desta vez seja 38.

Quando o código compara 50 com 38, o método cmp retorna

Ordering::Greater, porque 50 é maior que 38. A expressão match recebe o

valor Ordering::Greater e começa a verificar o padrão de cada braço. Ela olha

para o padrão do primeiro braço, Ordering::Less, e vê que o valor

Ordering::Greater não corresponde a Ordering::Less, então ignora o código

desse braço e segue para o próximo. O padrão do braço seguinte é

Ordering::Greater, que corresponde a Ordering::Greater! O código

associado a esse braço será executado e imprimirá Too big! na tela. A

expressão match termina após a primeira correspondência bem-sucedida, então

ela não verifica o último braço nesse cenário.

No entanto, o código da Listagem 2-4 ainda não compila. Vamos tentar:

$ cargo build

Compiling libc v0.2.86

Compiling getrandom v0.2.2

Compiling cfg-if v1.0.0

Compiling ppv-lite86 v0.2.10

Compiling rand_core v0.6.2

Compiling rand_chacha v0.3.0

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

error[E0308]: mismatched types

--> src/main.rs:23:21

|

23 | match guess.cmp(&secret_number) {

| --- ^^^^^^^^^^^^^^ expected `&String`, found `&{integer}`

| |

| arguments to this method are incorrect

|

= note: expected reference `&String`

found reference `&{integer}`

note: method defined here

--> /rustc/1159e78c4747b02ef996e55082b704c09b970588/library/core/src/cmp.rs:979:8

For more information about this error, try `rustc --explain E0308`.

error: could not compile `guessing_game` (bin "guessing_game") due to 1 previous error

A essência do erro é que existem tipos incompatíveis. Rust tem um sistema de

tipos forte e estático, mas também possui inferência de tipos. Quando

escrevemos let mut guess = String::new(), Rust conseguiu inferir que guess

deveria ser uma String, sem exigir que escrevêssemos isso explicitamente. Já

secret_number é um tipo numérico. Alguns dos tipos numéricos de Rust podem

conter um valor entre 1 e 100: i32, um número de 32 bits; u32, um inteiro

sem sinal de 32 bits; i64, um número de 64 bits; entre outros. A menos que

você especifique algo diferente, Rust usa i32 por padrão, então esse é o

tipo de secret_number, a menos que alguma informação em outro ponto faça o

compilador inferir outro tipo numérico. O erro acontece porque Rust não pode

comparar uma string com um tipo numérico.

No fim das contas, queremos converter a String lida da entrada em um tipo

numérico, para podermos compará-la numericamente com o número secreto. Fazemos

isso adicionando a linha a seguir ao corpo de main:

Nome do arquivo: src/main.rs

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}A linha é:

let guess: u32 = guess.trim().parse().expect("Please type a number!");Criamos uma variável chamada guess. Mas espere: o programa já não tem uma

variável com esse nome? Tem, mas, felizmente, Rust nos permite sombrear o

valor anterior de guess com um novo. Shadowing nos permite reutilizar o

nome da variável em vez de nos obrigar a criar duas variáveis diferentes, como

guess_str e guess, por exemplo. Veremos isso com mais detalhes no

Capítulo 3, mas, por enquanto, basta saber que

esse recurso é muito usado quando queremos converter um valor de um tipo para

outro.

Associamos essa nova variável à expressão guess.trim().parse(). O guess na

expressão se refere à variável guess original, que continha a entrada como

string. O método trim em uma instância de String remove qualquer espaço em

branco no início e no fim, o que precisamos fazer antes de converter a string

para u32, que só pode conter dados numéricos. A pessoa usuária precisa

pressionar

enter para satisfazer read_line e inserir seu palpite, o que

adiciona um caractere de nova linha à string. Por exemplo, se a pessoa usuária

digitar 5 e pressionar enter, guess ficará assim:

5\n. O \n representa “nova linha”. No Windows, pressionar

enter resulta em retorno de carro e nova linha, \r\n. O método

trim elimina \n ou \r\n, deixando apenas 5.

O método parse em strings converte uma string em

outro tipo. Aqui, nós o usamos para converter uma string em número. Precisamos

dizer ao Rust exatamente qual tipo numérico queremos usando

let guess: u32. Os dois-pontos (:) depois de guess dizem ao Rust que

vamos anotar o tipo da variável. Rust tem alguns tipos numéricos embutidos; o

u32 visto aqui é um inteiro sem sinal de 32 bits. Ele é uma boa escolha

padrão para um número pequeno e positivo. Você aprenderá sobre outros tipos

numéricos no Capítulo 3.

Além disso, a anotação u32 neste programa de exemplo, junto com a comparação

com secret_number, significa que Rust inferirá que secret_number também

deve ser um u32. Assim, agora a comparação será entre dois valores do mesmo

tipo!

O método parse só funcionará em caracteres que podem ser convertidos

logicamente em número e, portanto, pode falhar facilmente. Se, por exemplo, a

string contivesse A👍%, não haveria como convertê-la em número. Como isso

pode falhar, o método parse retorna um valor do tipo Result, assim como o

método read_line faz, como discutimos anteriormente em “Lidando com falhas

potenciais com Result”.

Vamos tratar esse Result da mesma forma, usando novamente o método expect.

Se parse retornar uma variante Err de Result porque não conseguiu criar

um número a partir da string, a chamada a expect encerrará o jogo e imprimirá

a mensagem que fornecemos. Se parse conseguir converter a string para número,

ele retornará a variante Ok de Result, e expect retornará o número que

queremos a partir do valor Ok.

Vamos executar o programa agora:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.26s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 58

Please input your guess.

76

You guessed: 76

Too big!

Muito bom! Mesmo com espaços antes do palpite, o programa ainda conseguiu entender que a pessoa usuária digitou 76. Execute o programa algumas vezes para observar o comportamento com diferentes tipos de entrada: acerte o número, escolha um número alto demais e depois um baixo demais.

Temos a maior parte do jogo funcionando agora, mas a pessoa usuária só pode dar um palpite. Vamos mudar isso adicionando um loop!

Permitindo Múltiplos Palpites com Looping

A palavra-chave loop cria um loop infinito. Vamos adicionar um loop para dar

mais chances de acertar o número:

Nome do arquivo: src/main.rs

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

// --snip--

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}

}Como você pode ver, movemos tudo a partir do prompt que pede o palpite para dentro de um loop. Certifique-se de recuar em mais quatro espaços as linhas dentro do loop e execute o programa novamente. Agora o programa pedirá outro palpite indefinidamente, o que introduz um novo problema: não parece haver uma forma de sair!

A pessoa usuária sempre pode interromper o programa usando o atalho de teclado

ctrl-C. Mas há outra forma de escapar desse monstro

insaciável, como mencionamos na discussão sobre parse em “Comparando o

Palpite com o Número Secreto”:

se a pessoa usuária inserir uma resposta que não seja número, o programa vai

encerrar. Podemos nos aproveitar disso para permitir que ela saia, como mostra

o exemplo a seguir:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.23s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 59

Please input your guess.

45

You guessed: 45

Too small!

Please input your guess.

60

You guessed: 60

Too big!

Please input your guess.

59

You guessed: 59

You win!

Please input your guess.

quit

thread 'main' panicked at src/main.rs:28:47:

Please type a number!: ParseIntError { kind: InvalidDigit }

note: run with `RUST_BACKTRACE=1` environment variable to display a backtrace

Digitar quit encerra o jogo, mas, como você pode notar, qualquer outra

entrada não numérica também o encerra. Isso está longe do ideal; queremos que o

jogo também termine quando o número correto for adivinhado.

Desistir após um palpite correto

Vamos programar o jogo para encerrar quando a pessoa usuária vencer,

adicionando uma instrução break:

Nome do arquivo: src/main.rs

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

// --snip--

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => {

println!("You win!");

break;

}

}

}

}Adicionar a linha break após You win! faz o programa sair do loop quando a

pessoa usuária acerta o número secreto. Sair do loop também significa sair do

programa, porque o loop é a última parte de main.

Tratamento de entrada inválida

Para refinar ainda mais o comportamento do jogo, em vez de travar o programa quando

o usuário insere um não-número, vamos fazer o jogo ignorar um não-número para que

o usuário pode continuar adivinhando. Podemos fazer isso alterando a linha onde

guess é convertido de String para u32, conforme mostrado na Listagem 2-5.

use std::cmp::Ordering;

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

let mut guess = String::new();

// --snip--

io::stdin()

.read_line(&mut guess)